Si te interesan la seguridad y la privacidad, y además estás usando explícitamente los chatbots de «inteligencia artificial» (IA), te vamos a plantear algunas preocupaciones que tenemos con respecto a su uso.

Como nuevas tecnologías que son, y teniendo en cuenta que se producen desde la centralidad capitalista, sabemos que lo único que les importa a las grandes corporaciones que las desarrollan es maximizar sus ganancias: si eso implica cuidar la privacidad y seguridad de las usuarias, lo harán. Pero si la competencia es por ver quién lanza más rápido una nueva versión de una nueva tecnología con más funcionalidad, podemos tener algunos problemas. Y justamente en ese caso nos encontramos.

No vamos a cubrir el hecho de que los buscadores como Google 1 o los mensajeros como WhatsApp están incorporando eso explícitamente para las usuarias. Tampoco incluimos el hecho de que ahora todo «es» o tiene IA: scripts, electrodomésticos, prótesis, webs, todo viene con IA. Aquí nos vamos a centrar en el caso cuando vos explícitamente abrís un chatbot para obtener resultados: sean laborales, de salud, emocionales, o por diversión.

Del uso cotidiano a la vigilancia sistemática

El uso de estas tecnologías está muy extendido y ha penetrado profundamente en la sociedad conectada (no olvidemos las brechas), tanto así que ha desplazado a los buscadores como forma de mantenernos informadas, resolver problemas y profundizar en el conocimiento. Algunas estadísticas indican que en 2023 ya un 35% de las personas dejaron de usar buscadores, con un crecimiento constante, así como un 70% de las personas encuestadas por “Consumer reports” declararon haber usado de alguna forma este tipo de tecnología en los últimos tres meses2. En la práctica, esto implica que millones de personas usan regularmente chatbots a los que les confían consultas personales, laborales, emocionales y políticas, entregando grandes cantidades de información sin que exista todavía una comprensión clara y compartida de cómo se protegen, almacenan, analizan o reutilizan estos datos.

Entonces es interesante ver que cada cosa que escribas y que cada archivo que subas será almacenado, analizado y utilizado por estas plataformas para mejorar sus negocios: sea «re entrenar los modelos», sea «perfilarte» para venderte publicidad o para venderte eso mismo que estuviste conversando con tus amistades. Incluso para saber tus inclinaciones políticas y ofrecerte el discurso que querés escuchar y así manipular elecciones políticas3.

Supuestamente no todas las empresas lo hacen de la misma forma; a algunas parece que sí les conviene mostrarse preocupadas con la privacidad de sus usuarias, como por ejemplo cuando Apple se jactaba de no colectar tantos metadatos como Facebook4 Amanda Caswell ha analizado la privacidad de varios chatbots, en su artículo «Comparación de privacidad de ChatGPT, Gemini, Perplexity y Claude» que te recomendamos leer.

También sabemos que las grandes corporaciones utilizan este BigData5 en colaboración con los Estados, para realizar una «vigilancia masiva» sobre toda la población, algo que Shoshana Zuboff ha denominado «capitalismo de vigilancia»6 y que se ha venido denunciando por décadas, con la primer comprobación fuertemente documentada a partir de las filtraciones de Edward Snowden7.

Tus datos, los chatbots y sus riesgos

Por otro lado, tampoco es que queramos promover el uso de esta tecnología tan controvertida y que se ha lanzado a la humanidad sin ningún tipo de control, pero sabemos que en mayor o menor medida, “todas”terminamos usándolas explícitamente de alguna forma (sin contar todo lo que las usamos sin saber, claro). Sabemos que además dan muy buenos resultados, por ejemplo analizando resultados médicos para encontrar problemas cuando hay millones de opciones por verificar. Ni nos oponemos a todo uso, ni promovemos su uso total como parecen estar haciendo algunas persona.

Todo esto tiene que ver con la privacidad de las personas, pero hay elementos que también implican problemas de seguridad8. Por ejemplo:

- ¿Qué pasa cuando estas plataformas son vulneradas y alguien extrae ese «BigData» de vos? 9

- ¿Qué pasa si alguien descarga todos sus «prompts» y todos tus archivos desde una de estas empresas? Quizás ese atacante obtenga tu información personal, tu dirección, tu estado de salud o emocional, imágenes de tus hijos o hijas, documentos de trabajo, etc, etc..

Si querés comprobarlo y utilizás alguno de estos bots con tu cuenta, digamos ChatGPT, podés ir a tu perfil (abajo a la izquierda), elegir «Configuración» y luego«Controles de datos» > «Exportar». La plataforma preparará y te enviará un comprimido con todas tus conversaciones y todos los archivos que subiste. Si hacés un uso medio o avanzado, te va a sorprender la cantidad de información que tienen sobre vos, y eso es solamente de la interfaz entre el bot y vos, no significa que sea todo lo que tienen de vos.

Estrategias de uso, privacidad por diseño y anonimización

Entonces si es que aún pensás usarlas, te recomendamos agregar un apartado en tu modelo de amenazas personal, o a en la protección digital de tu organización. ¿Cómo? Eso no podemos responderlo directamente: dependerá del tipo de uso y la profundidad en la que estás usando estas tecnologías, del tipo y tamaño de tu organización y de otros factores.

En esta línea te podemos recomendar dos plataformas que están centradas en promover la privacidad de las usuarias:

- Duck.ai (de DuckDuckGo) – permite utilizar varios modelos LLM de los conocidos en una instalación propia y sin siquiera la posibilidad de identificarte.

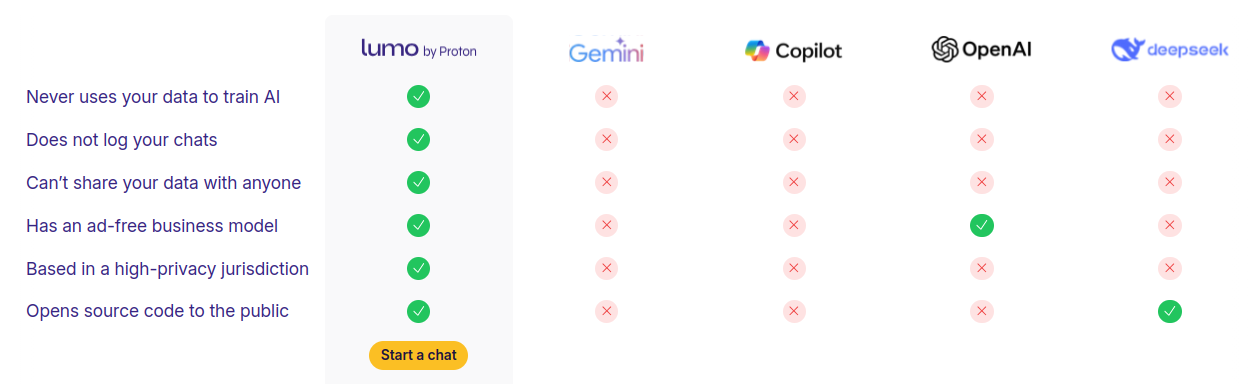

- LUMO (de Proton Fundation) – con ciertos límites de uso e identificación opcional.

Y aquí reproducimos una comparativa proveída justamente por la Proton Foundation:

Si de todos modos consideras que queres seguir usando directamente las conocidas, famosas y corporativas, existen varios casos en los que (al momento de escribir este artículo) no es necesario identificarte:

Esto es un poco más incómodo, porque varias de estas te van a limitar y te van a molestar pidiendo que te identifiques y a veces los resultados no serán tan perfectos como querés, pues los «agentes» sabrán menos de vos. Tampoco es garantía de que no te identifiquen y te metan de todos modos a su BigData, pero lo que sí pasa es que todos tus «prompts», todo lo que podrías descargar de tu cuenta, no estará disponible como material histórico en tu perfil. Tu rastro será menor y la asociación con tu identidad real también será menor. Si aún querés profundizar en la protección, podés intentar usar alguna de esas con el Navegador Tor. No será sencillo, pues ponen muchas trabas a su uso, pero podés intentarlo.

Entonces como conclusión te podemos decir, si vas a usar esta tecnología tan novedosa y controvertida, hacelo sin identificarte. Esperamos que en el futuro podamos contar con tecnología de vanguardia, pero con «privacidad y seguridad por diseño».

Imagen destacada: Remix de Stadio Alicante, con licencia como CC BY 2.0

La presente publicación ha sido financiada por la Unión Europea. Su contenido es responsabilidad exclusiva de TEDIC y no refleja necesariamente los puntos de vista de la Unión Europea.

Notas:

- Por cierto, si ya estás odiando que Google te de resultados como si fuera un bot, podés hacer dos cosas: i) usar otro buscador como duckduckgo o searX (listado de muchas instancias), o ii) Usar esta búsqueda más limpia: https://udm14.com/

- Ver informe: https://explodingtopics.com/blog/chatbot-statistics

- Como ejemplo de esto último, podemos citar el caso Cambridge Analítica, entre otros

- Ver esquema de colecta de metadatos de iMessage vs WhatsApp y otras en nuestro artículo sobre Signal.

- Término que ha dejado de estar de moda, pero no de estar vigente. Lee más en: https://es.wikipedia.org/wiki/Macrodatos

- https://es.wikipedia.org/wiki/Capitalismo_de_vigilancia

- Accede a la biografía de Snowden y los detalles de su caso en: https://es.wikipedia.org/wiki/Edward_Snowden

- Si sos un poco nerd y querés investigar más en profundidad los problemas de seguridad de estas tecnologías, te recomendamos este video del «Chema Alonso» sobre el tema

- Basta realizar cualquier tipo de búsqueda para comprobar la cantidad de veces que esto ya ha pasado.

Consentimiento y cifrado de las comunicaciones, claves para un sexting seguro

Consentimiento y cifrado de las comunicaciones, claves para un sexting seguro  Bitcoin para no informáticos – Entrega 3: ¿cuántas criptomonedas hay?

Bitcoin para no informáticos – Entrega 3: ¿cuántas criptomonedas hay?